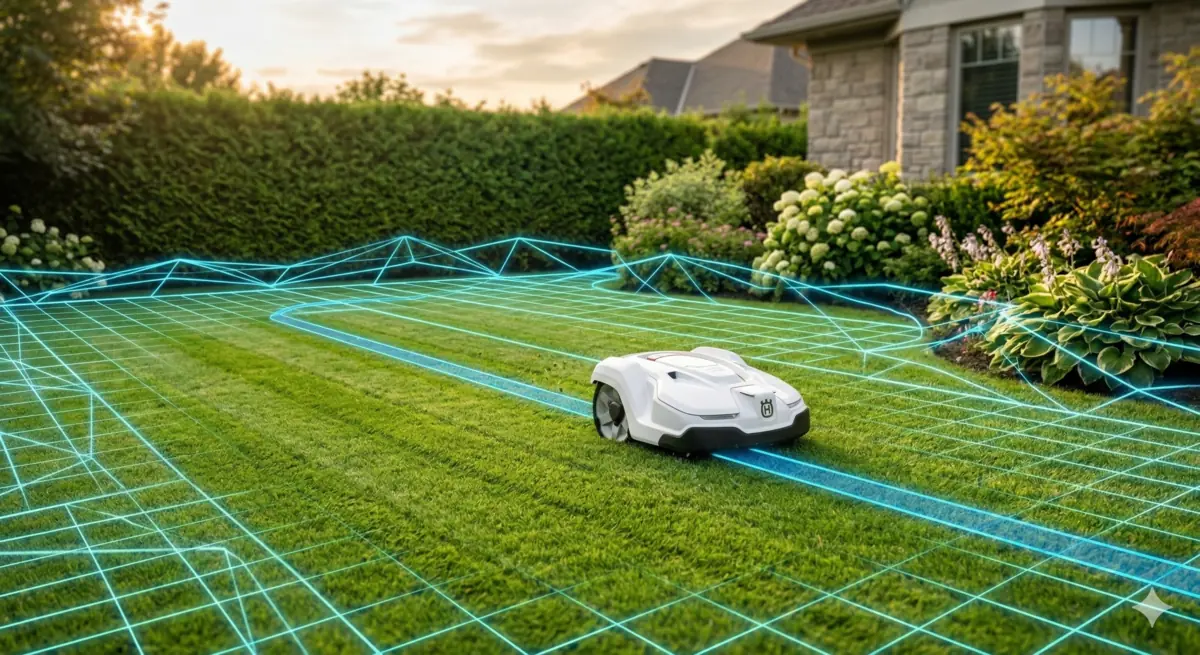

En 2026, un robot tondeuse de 4 500 € ne "roule plus" : il voit, il comprend, il anticipe. La caméra stéréo scrute la pelouse à 30 images par seconde, le LiDAR balaie 360° pour cartographier chaque obstacle au centimètre, et un SoC embarqué (Rockchip RK3588 ou équivalent) fait tourner des réseaux de neurones capables de distinguer un hérisson d'une pomme tombée du pommier. On est loin du petit robot aléatoire des années 2000 qui se cognait à chaque pierre.

Cette révolution n'est pas purement technique : elle change fondamentalement l'expérience utilisateur. Fini la pose de fil périmétrique, fini les zones interdites à recréer manuellement à chaque déménagement de trampoline, fini le robot qui mange le coussin oublié sur la pelouse. Dans cet article, nous dressons le panorama complet de l'IA embarquée sur les robots tondeuses en 2026 : les technologies, les modèles phares, les limites réelles et le futur proche. Nous nous appuyons sur nos tests produits, les publications techniques des fabricants et les retours communautaires (Dreame, Ecovacs Goat, Segway Navimow).

1. De la navigation aléatoire à l'IA : 30 ans d'évolution

Comprendre la rupture de 2026 nécessite un rapide coup d'œil dans le rétroviseur. Le robot tondeuse domestique est né en 1995 avec l'Electrolux Automower, suivi rapidement par Husqvarna. Pendant vingt ans, le paradigme reste identique : un fil périmétrique délimite la zone, le robot se déplace en mode pseudo-aléatoire, et un capteur de choc gère les obstacles.

| Époque | Technologie dominante | Intelligence |

|---|---|---|

| 1995 - 2005 | Fil périmétrique, capteur de choc | Réactive : choc → demi-tour |

| 2005 - 2015 | Fil + GPS basique + zones virtuelles | Pseudo-aléatoire optimisé |

| 2015 - 2020 | GPS RTK, cartographie, ultrasons | Planification en lignes parallèles |

| 2020 - 2024 | Vision monoculaire + ML embarqué | Détection d'obstacles (partielle) |

| 2024 - 2026 | Vision stéréo + LiDAR + fusion capteurs | Compréhension sémantique de la scène |

Le déclencheur de 2024-2025 a été la démocratisation des SoC ARM avec NPU (Neural Processing Unit) intégrés. Un Rockchip RK3588 coûte moins de 40 € à la pièce et délivre 6 TOPS d'inférence neuronale — assez pour faire tourner en temps réel un modèle YOLOv8 de détection d'objets. Cette puissance de calcul a rendu la vision embarquée non plus un gadget, mais la colonne vertébrale de la navigation.

2. Les 3 piliers de l'IA moderne sur robot tondeuse

En 2026, trois technologies structurent l'intelligence d'un robot tondeuse haut de gamme. Elles ne s'opposent pas : elles se complètent. Comprendre leur rôle respectif aide à décrypter les fiches produits et à faire le bon choix.

Vision par ordinateur

Caméras (mono, stéréo ou panoramique) + CNN embarqué. Identifie la nature des objets : herbe, sol nu, jouet, humain, animal, ombre. Sensible à la luminosité mais irremplaçable pour la sémantique.

LiDAR 3D

Faisceau laser tournant ou matriciel. Mesure distances et reliefs à +/-1 cm sur 10-20 m. Indépendant de la lumière, résistant à la nuit, gêné par la pluie battante et le brouillard dense.

Fusion de capteurs

RTK centimétrique + IMU + ultrasons + roues codeuses. L'assemblage statistique (filtre de Kalman) compense les défaillances individuelles et offre une robustesse globale.

3. Vision par ordinateur : ce que le robot détecte réellement

La vision par ordinateur dans un robot tondeuse repose sur trois composants : une ou plusieurs caméras (généralement 1080p à 60 fps), un ISP (Image Signal Processor) qui corrige contraste et exposition, et un réseau neuronal convolutif (CNN) entraîné sur des millions d'images de jardins. Le résultat : une classification sémantique en temps réel de chaque pixel visible.

Ce que le robot voit et reconnaît en 2026

- ✓Herbe vs non-herbe — la segmentation sémantique distingue la pelouse, l'allée, le massif, la terrasse. Fiabilité : 98 % sur pelouse en bon état, 85 % sur pelouse rase ou jaunie.

- ✓Humains — détection à 2-5 m avec arrêt des lames. Fiabilité > 99 % en conditions diurnes.

- ✓Animaux domestiques — chien, chat. Fiabilité 92-98 % selon la taille et la luminosité.

- ✓Jouets, câbles, outils — classe "obstacle mobile". Fiabilité 85-95 % selon taille et couleur.

- ✓Fruits tombés, crottes — modèles récents entraînés (Worx Vision, robots anti-crotte de chien). Fiabilité 75-90 %.

- ✓Terrain humide/détrempé — détection via brillance et texture. Évite le patinage et l'ornière.

- ⚠Hérisson, tortue, amphibiens — détection partielle, en progrès. Fiabilité 60-80 %, souvent via partenariats naturalistes.

Les trois systèmes vision de référence en 2026

Mammotion Pano-View 360°

FlagshipTriple caméra sur le LUBA 3 AWD, champ panoramique 360° fusionné. Couplé au RTK et au LiDAR ToF pour une fusion complète. Modèle de vision propriétaire entraîné sur plus de 10 millions d'images de jardins européens et américains. Détection d'humains à 3 m, arrêt lame en 0,3 s.

Worx Landroid Vision

Sans fil, sans RTKCaméra frontale unique 1080p + IA propriétaire entraînée par 4 ans de données terrain. Particularité : Worx fonctionne sans fil et sans RTK, uniquement sur la vision. Le Vision M800 et le Vision L1600 démontrent la viabilité de la pure vision sur terrains jusqu'à 1 600 m².

Ecovacs AIVI 3.0

Détection avancéeSystème AI Visual Interactive de troisième génération sur le Ecovacs Goat G1-2000. Double caméra + capteur ToF frontal. Base de données de plus de 200 catégories d'objets. Capable de reconnaître les zones déjà tondues dans la journée et d'optimiser le parcours en conséquence.

Répondez à 6 questions, recevez gratuitement une sélection personnalisée adaptée à votre surface, votre budget et vos contraintes.

4. LiDAR : la précision issue du monde militaire

Le LiDAR (Light Detection And Ranging) est une technologie issue des années 1960, d'abord utilisée en météorologie puis en défense. Elle fonctionne simplement : un laser émet des impulsions, on mesure le temps de retour, on en déduit la distance. Répété des millions de fois par seconde et dans toutes les directions, ce procédé génère un nuage de points 3D de l'environnement.

En 2026, le LiDAR a quitté les voitures autonomes haut de gamme pour s'installer dans les robots tondeuses. La raison : l'effondrement du prix. Un LiDAR 360° basique coûte désormais 60-90 € à la pièce (contre 75 000 € il y a dix ans). Deux architectures dominent :

LiDAR rotatif 360°

Un miroir tournant à 5-10 Hz balaie l'environnement en cercle. Portée typique : 12-20 m. Précision : +/-1 à 2 cm.

Exemples : Segway Navimow i2, Dreame A2

LiDAR solide ToF

Matrice de diodes statiques, couverture plus limitée (60-120° frontal). Moins précis mais plus robuste mécaniquement.

Exemples : Mammotion LUBA 3 (complément), Ecovacs Goat

Les robots LiDAR de référence en 2026

- ▸Segway Navimow i2 LiDAR — LiDAR 360° rotatif + RTK. Cartographie automatique en 20 minutes sur 1 500 m². Fonctionne la nuit. Détection d'obstacles à 15 m.

- ▸Dreame A2 — Double LiDAR (panoramique + frontal) sur la plateforme OmniSense 2. SLAM en temps réel, précision annoncée < 1 cm sur la cartographie. Jusqu'à 8 000 m² gérables.

- ▸Segway Navimow X3 — Déclinaison pro du i2, LiDAR haute portée 30 m pour les terrains jusqu'à 10 000 m².

5. Fusion de capteurs : RTK + vision + ultrasons = fiabilité

Aucune technologie n'est parfaite seule. La vision échoue dans l'obscurité, le LiDAR dans le brouillard, le RTK sous un feuillage dense. La solution pratiquée par tous les leaders du marché en 2026 s'appelle la fusion de capteurs : combiner plusieurs sources d'information dans un algorithme statistique (généralement un filtre de Kalman étendu ou un filtre particulaire) pour obtenir une estimation plus robuste que la somme des parties.

Architecture type d'un robot IA 2026

Le filtre fusionne toutes ces entrées 20 à 50 fois par seconde. Résultat : si le RTK perd temporairement ses satellites sous un cerisier, la vision et l'odométrie prennent le relais pendant quelques secondes, le temps de retrouver le ciel dégagé. Cette redondance est ce qui sépare un robot "intelligent sur le papier" d'un robot "intelligent en conditions réelles".

6. Détection d'animaux : qui protège la faune ?

C'est la problématique qui a le plus mobilisé la presse spécialisée et les associations naturalistes ces deux dernières années. Les robots tondeuses, lorsqu'ils tournent de nuit ou tôt le matin, ont été accusés de blesser massivement la petite faune, notamment les hérissons européens (espèce protégée en France et en recul de 70 % en 20 ans).

Les fabricants ont réagi. En 2026, plusieurs marques intègrent une détection animale explicite, souvent fruit de partenariats avec des chercheurs ou des associations :

| Marque / Modèle | Chien/Chat | Hérisson | Oiseau au sol |

|---|---|---|---|

| Mammotion LUBA 3 AWD | Oui, 99 % | Oui, ~90 % | Partiel |

| Segway Navimow i2 | Oui, 98 % | Oui, ~85 % | Partiel |

| Ecovacs Goat G1 | Oui, 97 % | Inconsistant | Non fiable |

| Worx Landroid Vision | Oui, 96 % | Détection limitée | Non fiable |

| Husqvarna Automower (fil) | Choc uniquement | Non | Non |

7. IA générative et robots : la perspective 2026

Avec l'explosion de l'IA générative (ChatGPT, Claude, Gemini), une question se pose : que font ces modèles sur un robot tondeuse ? La réponse honnête : pas grand-chose d'utile pour l'instant, mais ça évolue vite.

Les vrais LLM (Large Language Models) ne tournent pas sur un robot tondeuse — ils demandent des dizaines de gigaoctets de RAM et un GPU dédié. Ce qui tourne sur un robot, ce sont des modèles spécialisés entraînés pour la vision (YOLOv8, SegFormer) ou la segmentation (DeepLab). Mais l'IA générative trouve sa place côté cloud et application mobile :

- ▸Assistant conversationnel — Mammotion et Dreame testent des assistants LLM dans leur app : "mon robot patine sur la pente sud, que faire ?" → diagnostic contextualisé.

- ▸Génération de plans de tonte — soumettre une photo aérienne du jardin et demander au LLM de proposer zones prioritaires, horaires optimaux et couloirs de passage. Expérimenté chez quelques marques.

- ▸Apprentissage continu — les images collectées par les robots (avec consentement utilisateur) alimentent des jeux d'entraînement qui affinent les modèles embarqués à chaque mise à jour firmware.

- ▸Diagnostic SAV automatisé — l'utilisateur envoie une photo ou une vidéo d'un problème, un LLM analyse et propose une solution avant d'escalader vers un technicien.

8. Les limites actuelles de l'IA embarquée

Soyons honnêtes : même les modèles flagship de 2026 ont leurs angles morts. Voici les limites que nous avons constatées en tests et que les communautés d'utilisateurs remontent régulièrement.

Brouillard et pluie battante

Caméras perturbées par les gouttes sur la lentille, LiDAR gêné par la diffusion des particules d'eau. La plupart des robots se mettent en pause quand la pluie est détectée. Voir notre guide robot tondeuse sous la pluie.

Contre-jour extrême

Soleil bas (matin/soir) qui éclaire directement la caméra : perte de 40 à 60 % de précision. Les LiDAR ne sont pas affectés, d'où l'intérêt de la fusion.

Objets inconnus ou déformés

Un jouet écrasé, un sac plastique roulé par le vent, une peluche mouillée : formes imprévues mal classées, pouvant être prises pour de l'herbe haute ou un simple tas.

Sol détrempé

Détection via brillance et texture, mais les conditions intermédiaires (terrain simplement humide) posent des faux positifs. Le robot peut refuser de sortir alors que la tonte serait possible.

Herbe très haute

Au-delà de 15 cm, la caméra ne voit pas à travers et la cartographie se dégrade. Un premier passage manuel peut être nécessaire. Voir notre article robot tondeuse herbe haute.

Dépendance firmware

Un modèle vision peut régresser après une mise à jour (déjà constaté chez plusieurs marques en 2025). L'IA embarquée est un composant logiciel en évolution permanente.

Filtre spécifique "IA & Vision" dans notre comparateur : Mammotion, Segway, Dreame, Worx, Ecovacs, tous les modèles face à face.

9. Le futur proche : semantic SLAM, robots sociaux, swarm

Trois tendances structurent la feuille de route R&D des leaders pour 2027-2030. Nous les avons identifiées en recoupant les publications des principaux fabricants, les brevets déposés et les conférences robotiques (ICRA, IROS, CES).

Semantic SLAM

Aujourd'hui, la cartographie fusionne LiDAR et RTK pour produire un plan géométrique. Demain, le SLAM sémantique ajoute le sens : "ici c'est une allée en gravier", "là c'est le massif de rosiers", "le portail s'ouvre à droite". Le robot comprend la topologie fonctionnelle de votre jardin et non plus seulement sa géométrie.

Robots sociaux

Interaction vocale bidirectionnelle, reconnaissance des membres du foyer, adaptation du comportement au contexte humain ("l'enfant joue dans la zone sud, je tonds ailleurs"). Premières démonstrations chez Mammotion en 2025, déploiement commercial prévu 2027.

Swarm robotics

Plusieurs robots qui se coordonnent pour tondre une grande surface. Chaque robot contribue à la cartographie collective, partage ses observations et s'adapte aux positions des autres. Application pratique pour les pros du paysage et terrains > 1 hectare.

Apprentissage fédéré

Chaque robot apprend localement et envoie uniquement les gradients (pas les images brutes) à un serveur central. Confidentialité renforcée, modèles qui s'améliorent avec l'usage collectif sans exposer vos données. Technique déjà utilisée par Apple sur iPhone, en cours d'adoption par les fabricants de robots.

10. Acheter en 2026 : les 3 modèles qui poussent l'IA le plus loin

Si vous cherchez ce qui se fait de plus avancé aujourd'hui, trois robots se détachent. Ils ne sont pas bon marché mais ils représentent l'état de l'art en matière d'intelligence embarquée.

Mammotion LUBA 3 AWD

Le flagship de la marque chinoise qui a bouleversé le marché haut de gamme. 4 roues motrices, RTK centimétrique, vision panoramique Pano-View 360° couvrant tout le jardin et LiDAR ToF frontal. Pentes jusqu'à 38°. Jusqu'à 10 000 m² supportés. Voir notre comparatif Kress / Husqvarna / Mammotion pour situer la marque.

Voir la fiche produit →Segway Navimow i2 LiDAR

Le meilleur rapport qualité/prix de la catégorie LiDAR. Cartographie automatique en 15-20 minutes, tonte de nuit possible, détection d'obstacles à 15 m. Idéal pour terrains jusqu'à 1 500 m² avec obstacles fixes nombreux (arbres, massifs, mobilier de jardin). Segway capitalise sur son héritage trottinettes pour la mécanique.

Voir la fiche produit →Dreame A2

Le petit dernier de Dreame (marque chinoise connue pour ses aspirateurs haut de gamme) pousse la double détection LiDAR plus loin que la concurrence. Jusqu'à 8 000 m², cartographie SLAM en temps réel, intégration Matter/Home Assistant prévue. Notre test approfondi dans l'article Dreame tondeuses.

Voir la fiche produit →Questions fréquentes

Dites-nous tout de votre jardin (surface, pente, obstacles, animaux) et recevez une sélection parmi les robots IA les mieux adaptés.

Filtrez par vision, LiDAR, fusion de capteurs. Comparez les modèles face à face sur plus de 30 critères.

Accéder au comparateur →